-

prix: $0.15090 2.9605%

-

Valeur marchande: 22.92B 0.7601%

-

Chiffre d’affaires (24h): 1.55B 0%

-

Dominance: 0.7601% 0.7601%

-

prix: $0.15090 2.9605%

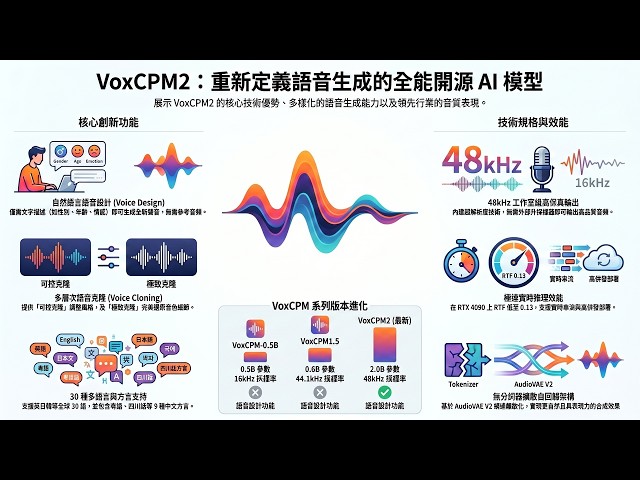

🎯 Le dialecte Hokkien peut également être doublé par l'IA ! Les paramètres 2B battent 7B ! VoxCPM2 analyse entièrement trente langues + neuf dialectes et utilise des modèles plus petits pour créer des sons plus réalistes.

libérer: 2026/05/11 04:51 lire: 0

Auteur original:AI 論文白話文

Source originale:https://www.youtube.com/embed/afnxVzN_ZF4

🎤 Ce modèle vocal open source est un peu différent. Ce qui suscite des discussions dans la communauté technique, ce n’est pas l’échelle, mais les avancées architecturales ! VoxCPM2 — Équipe OpenBMB : 🧠 Percée de base : diffusion autorégressive → Dites adieu complètement aux jetons discrets 🔊 Qualité sonore haute fidélité native de 48 kHz (aucun convertisseur externe requis) 🌍 30 langues mondiales + 9 dialectes chinois (y compris le hokkien !) 🎭 Conception vocale : description textuelle pure → créez de nouveaux sons à partir de rien 🎯 Clonage double piste : clonage contrôlable (flexible) + clonage ultime (fidélité) 📊 Seed-TTS Benchmark : 2B paramètres battent 7B Qwen2.5-Omni ⚡ RTF 0.13 (accélération Nano-vLLM) → 7 fois plus rapide que la parole humaine 💾 Minimum 8 Go de VRAM pour exécuter 🆓 Apache 2.0 entièrement open source et disponible pour un usage commercial 💻 GitHub : https://github.com/OpenBMB/VoxCPM 🤗 HuggingFace : https://huggingface.co/openbmb/VoxCPM2 📄 Documents officiels : https://voxcpm.readthedocs.io/en/latest/models/voxcpm2.html [Chapitre 1 : Percée de l'architecture de base] 0:00 - VoxCPM2 (OpenBMB) : 2 milliards de paramètres, plus de 2 millions d'heures de formation, Apache 2.0 est entièrement open source et peut être commercialisé 0:18 - Architecture autorégressive de diffusion : dites adieu aux jetons discrets, utilisez une représentation vocale continue pour générer directement une qualité sonore haute fidélité native de 48 kHz, sans avoir besoin de convertisseurs externes [Chapitre 2 : 30 langues + 9 dialectes] 0:55 - Prise en charge native de 30 langues mondiales, sortie directe sans échantillon (aucune balise de langue requise) 1:31 - Optimisation en profondeur de 9 dialectes chinois, couvrant le "Minnan", qui est rarement pris en charge nativement dans l'industrie open source [Chapitre 3 : Conception de la voix (Texte pur pour créer des sons)] 1:56 - Une description textuelle pure (comme le genre/l'émotion/la vitesse de la parole) peut créer une nouvelle voix à partir de rien, sans aucune référence à l'audio 2:19 - Avec une forte conscience du contexte, une description textuelle est un mixeur dédié [Chapitre 4 : Voix double piste clonage] 2:53 - Clonage contrôlable (audio 16 kHz + texte) : modifiez de manière flexible les émotions et la vitesse de parole, adapté aux ancres virtuelles 3:22 - Clonage ultime (audio + verbatim) : basé sur la continuation audio, 100 % de fidélité pour chaque pause respiratoire, adapté à la réparation de la voix [Chapitre 5 : La sensation naturelle de Tokenizer Free] 3:53 - Dites adieu à la perte de détails acoustiques causée par la segmentation forcée des jetons traditionnels 4:18 - Opérant directement dans l'espace potentiel continu, la forme d'onde est douce et naturelle, conservant parfaitement les hauts et les bas subtils des émotions humaines [Chapitre 6 : Mise à l'échelle native d'AudioVAE V2] 4:46 - Conception de codec asymétrique, complétant directement la super résolution de 16 kHz à 48 kHz dans le modèle 5:12 - Abandon de l'échantillonneur externe, réduisant les coûts de maintenance et les points de défaillance pour le déploiement en entreprise [Chapitre 7 : Inférence de bout en bout en cinq étapes] 5:22 - Entrée → Compréhension (MiniCPM-4) → Génération (diffusion autorégressive) → Rendu (AudioVAE V2) → Sortie (0,13 RTF) pour créer un système d'exploitation acoustique complet [Chapitre 8 : Trois générations d'évolution saute-mouton] 5:56 - Paramètres mis à niveau de 0,5B à 2B, entièrement étendus à 30 langues et fonctionnalités complètes support 6:42 - Taux de jeton LM réduit de manière stable à 6,25 Hz pour garantir des performances ultimes [Chapitre 9 : Données de référence hardcore] 6:50 - Seed-TTS : le modèle 2B (WER 1.84/SIM 75.3) bat le meilleur modèle open source 7B 7:29 - 30 Langue ASR (test interne) : le taux d'erreur moyen global n'est que de 1,68 % 8:13 - InstructTTSEval : Les trois principaux indicateurs de commande émotionnelle dominent la liste, prouvant sa profonde compréhension sémantique [Chapitre 10 : Inférence et déploiement extrêmement rapides] 8:46 - Performances de vitesse : standard PyTorch 0,30 RTF ; Nano-vLLM accélère jusqu'à un étonnant 0,13 RTF 9:07 - Prend en charge le déploiement à haut débit vLLM-Omni, fournissant une API compatible OpenAI pour un docking parfait [Chapitre 11 : Réglage fin et écosystème open source] 9:20 - Seules 5 à 10 minutes d'audio peuvent être utilisées pour effectuer un réglage SFT (profond) ou LoRA (léger) Un réglage fin pour créer des sons exclusifs 10:04 - Couvertures écosystème serveur/Edge/ComfyUI, peut fonctionner avec un minimum de 8 Go de VRAM 10:43 - Options TTS open source à tester absolument en 2026, il est fortement recommandé d'accéder à la démo officielle Vérifier personnelle scénarios━━━━━━━━━━━━━━━━━━━━━━ 📊 Données de base (strictement basées sur le contenu SRT) ━━━━━━━━━━━━━━━━━━━━━━ • Développeur : OpenBMB Team • Licence : Apache 2.0 (entièrement open source, disponible dans le commerce) • Architecture : Diffusion Autorégressive → Tokenizer Free • Réseau fédérateur : MiniCPM-4 • Paramètres : 2B (2 milliards) • Données de formation : plus de 2 millions d'heures de parole multilingue • Taux d'échantillonnage natif : 48 kHz (qualité studio, aucun convertisseur externe requis) • Langues : 30 langues mondiales • Dialectes : 9 dialectes chinois (y compris le hokkien) • Exigences de VRAM : minimum ~ 8 Go • Taux de jeton LM : 6,25 Hz Vitesse d'inférence : PyTorch standard : RTF 0,30 Nano-vLLM Accélération : RTF 0,13 (environ 7 fois plus rapide que les humains) Quatre fonctions principales : 1. Voice Design (Voice Design) : description textuelle pure → créer des sons à partir de rien 2. Clone contrôlable (Controllable) : audio de référence + texte → vitesse d'émotion/de parole modifiable 3. Ultimate Clone (Ultimate) : audio de référence + brouillon verbatim → continuation d'une fidélité parfaite 4. Multilingue à échantillon zéro (Zero Shot) : identification automatique des modules de base sans balises de langue : LocEnc → TSLM → RALM → LocDiT → AudioVAE V2 (16 → 48 kHz) Benchmark (données mentionnées dans SRT) : Seed-TTS : WER 1,84 / SIM 75,3 (2B gagne 7B Qwen2.5-Omni) 30 Langue ASR : Taux d'erreur moyen mondial 1,68 % Anglais 0,42 % / Chinois 0,92 % / Arabe 1,23 % / Indonésien 1,36 % InstructTTSEval : APS 84.2 / DSD 83.2 / RP 71.4 (le plus élevé des trois) ⚠️ L'ASR en 30 langues est un test interne, une intégration de déploiement d'évaluation indépendante non tierce : • Nano-vLLM / vLLM-Omni (serveur à haut débit) • ONNX multiplateforme/Apple Neural Engine • Nœud ComfyUI • API compatible OpenAI/v1/audio/parole • Réglage fin LoRA (commutation multi-timbrale légère) Trois générations d'évolution : VoxCPM-0.5B (génération originale) : 0,5B / chinois et anglais / 16kHz / 12,5Hz VoxCPM-1.5 (stable) : 0,8B / chinois-anglais / 44,1kHz / 6,25Hz VoxCPM2 (dernière) : 2B / 30 langues + 9 dialectes / 48 kHz / 6,25 Hz ━━━━━━━━━━━━━━━━━━━━━━ 🎯 Application de grande valeur zones━━━━━━━━━━━━━━━━━━━━━━ ✅ Ancre virtuelle : clonage contrôlable + commutation instantanée de plusieurs émotions ✅ Livre audio dynamique : contrôle émotionnel + rôles multiples ✅ Restauration de la voix historique : restauration fidèle du clonage ultime ✅ Discours suite : Suite transparente de styles spécifiques ✅ Produits mondiaux : 30 langues sans échantillons ✅ Marché taïwanais : prise en charge native de Hokkien (open source uniquement) ✅ Voix exclusive à l'entreprise : 5 à 10 minutes de données → Réglage fin LoRA → en ligne ⚠️ GPU requis (minimum ~ 8 Go de VRAM) ⚠️ Les résultats de la conception vocale peuvent être légèrement différents à chaque fois ⚠️ ASR en 30 langues Pour le test interne data━━━━━━━━━━━━━━━━━━━━━━ 🎬 Méthode d'expérience de démonstration (mentionnée uniquement sur la base de SRT) ━━━━━━━━━━━━━━━━━━━━━━ Suggestion à la fin de la vidéo : "Allez lancer la page de démonstration officielle et essayez-la avec votre propre scénario d'utilisation" 🔗 GitHub : https://github.com/OpenBMB/VoxCPM 🤗 HuggingFace : https://huggingface.co/openbmb/VoxCPM2 Déploiement local : pip install voxcpm Suggestions de script de démonstration (correspondant strictement au contenu SRT) : 1. Conception de la voix : saisissez « voix masculine grave, triste, parole lente » + texte → observez l'effet à partir de rien 2. Clonage contrôlable : fournissez un audio de référence 16 kHz → changez l'émotion et la vitesse de parole → comparez le son original 3. Clonage ultime : audio de référence + script Verbatim → Vérifiez la fidélité de chaque respiration et pause 4. Échantillon zéro multilingue : Pas de balises de langue → Saisir directement le texte chinois/anglais/japonais/français → Observer la reconnaissance automatique 5. Test Hokkien : Saisir le texte Hokkien → Vérifier la qualité du dialecte Matériel gratuit (audio de référence) : • Enregistrez simplement 5 à 10 secondes de voix claire par vous-même • Common Voice https://commonvoice.mozilla.org/ (données vocales multilingues) set) • LibriSpeech https://www.openslr.org/12/ (Voix anglaise) #VoxCPM2 #OpenBMB #Speech Synthesis #TTS #DiffusionAutoregressive #TokenizerFree #48kHz #Voice Design #VoiceDesign #Voice Clone #30 Language #Min Nan Dialect #Chinese Dialect #MiniCPM4 #AudioVAE #LoRA #Open Source TTS #Apache2 #VoiceCloning #ZeroShot #VoiceAI ════════════════════════════════ ⚠️ Avis de non-responsabilité ═══════════════════════════════════ Cette vidéo est une interprétation de projets éducatifs open source et examen technique. Le contenu est basé sur le référentiel GitHub officiel d'OpenBMB, la carte modèle HuggingFace et les documents techniques. Il s'agit d'une traduction directe des documents originaux non officiels. Les droits d'auteur de tous les codes, poids de modèle, données de référence et contenus cités appartiennent à l'équipe OpenBMB et à la communauté open source. Certains tests de référence sont des données internes et ne constituent pas des évaluations tierces indépendantes. Veuillez vous conformer aux lois et réglementations locales lorsque vous utilisez la fonction de clonage vocal et ne pouvez pas l'utiliser pour frauder ou usurper l'identité d'autrui. La mise en œuvre technique est sensible au temps. Si vous avez des questions, assurez-vous de vous référer au référentiel officiel pour obtenir les dernières informations. 🔗 https://github.com/OpenBMB/VoxCPM

nouvelles récentes

Plus>>-

Electro Cubos

2026-05-11 14:50

Electro Cubos

2026-05-11 14:50

-

Zala2626

2026-05-11 14:38

Zala2626

2026-05-11 14:38

-

Thohir - block

2026-05-11 14:38

Thohir - block

2026-05-11 14:38

-

剧能充电站

2026-05-11 14:38

剧能充电站

2026-05-11 14:38

-

C-Minidrama

2026-05-11 14:38

C-Minidrama

2026-05-11 14:38

-

Sweety Theater

2026-05-11 14:16

Sweety Theater

2026-05-11 14:16

-

RushMiniDrama

2026-05-11 14:16

RushMiniDrama

2026-05-11 14:16

-

破晓动漫社 Dawn Anime Club

2026-05-11 14:16

破晓动漫社 Dawn Anime Club

2026-05-11 14:16

-

AI 論文白話文

2026-05-11 13:55

AI 論文白話文

2026-05-11 13:55

Sujets en vedette

-

- Activité des baleines Dogecoin

- Obtenez les dernières informations sur les activités des baleines Dogecoin grâce à notre analyse complète. Découvrez les tendances, les modèles et l'impact de ces baleines sur le marché Dogecoin. Restez informé grâce à notre analyse d’experts et gardez une longueur d’avance dans votre parcours de crypto-monnaie.

-

- Extraction de Dogecoins

- Le minage de Dogecoin est le processus d'ajout de nouveaux blocs de transactions à la blockchain Dogecoin. Les mineurs sont récompensés par un nouveau Dogecoin pour leur travail. Cette rubrique propose des articles liés au minage de Dogecoin, notamment sur la manière d'exploiter du Dogecoin, les meilleurs matériels et logiciels de minage et la rentabilité du minage de Dogecoin.

-

- Lancement du vaisseau Spacex

- Cette rubrique fournit des articles relatifs aux lancements de SpaceX Starship, notamment les dates de lancement, les détails de la mission et l'état du lancement. Restez au courant des derniers lancements de SpaceX Starship avec cette ressource informative et complète.

-

- Roi des mèmes : Dogecoin

- Cette rubrique propose des articles liés aux mèmes les plus populaires, notamment « Le roi des mèmes : Dogecoin ». Memecoin est devenu un acteur dominant dans l’espace crypto. Ces actifs numériques sont populaires pour diverses raisons. Ils pilotent les aspects les plus innovants de la blockchain.

Articles en vedette

Plus>>- 1 Arctic Pablo Coin (APC): Découvrir les mystères de la Terre, une prévente à la fois

- 2 Nouveaux sommets pour Dogecoin, Pepe et Shiba Inu en 2025, mais cette crypto pourrait voler le spectacle avec 10 000% de gains

- 3 Meme Coin Doge Uprising (DUP) pourrait 100 fois après que le président Donald Trump annonce la réserve stratégique de crypto

- 4 Prédiction de prix de Dogecoin (DOGE): Meme Coin a-t-elle atteint 10 $ d'ici la fin de 2025?

- 5 Charles Hoskinson de Cardano a fait des remarques notables sur Bitcoin et Dogecoin

- 6 Cloud Mining Craze: Bitcoin, Dogecoin et la quête du revenu cryptographique passif

- 7 Grayscale, Dogecoin et les débuts de l'ETF : une nouvelle ère pour les Meme Coins ?

- 8 Rexas Finance (RXS) pourrait augmenter 10x d'ici 2025, dépassant Pepe (Pepe)

- 9 Bitcoin Trader qui a fait 30 millions de dollars sur DOGE prévoit une augmentation de 6 000% pour ce jeton AI de 0,0000002 $ - Obtenez des jetons bonus de 80%

- 10 Prédiction de prix de Dogecoin (DOGE): la pièce de mème pourrait se rassembler à 0,27 $ car elle se ferme au-dessus

Sélectionnez la devise

US Dollar

USD

Chinese Yuan

CNY

Japanese Yen

JPY

South Korean Won

KRW

New Taiwan Dollar

TWD

Canadian Dollar

CAD

Euro

EUR

Pound Sterling

GBP

Danish Krone

DKK

Hong Kong Dollar

HKD

Australian Dollar

AUD

Brazilian Real

BRL

Swiss Franc

CHF

Chilean Peso

CLP

Czech Koruna KČ

CZK

Singapore Dollar

SGD

Indian Rupee

INR

Saudi Riyal

SAR

Vietnamese Dong

VND

Thai Baht

THB

Sélectionnez la devise

-

US Dollar

USD-$

-

Chinese Yuan

CNY-¥

-

Japanese Yen

JPY-¥

-

South Korean Won

KRW -₩

-

New Taiwan Dollar

TWD-NT$

-

Canadian Dollar

CAD-$

-

Euro

EUR - €

-

Pound Sterling

GBP-£

-

Danish Krone

DKK-KR

-

Hong Kong Dollar

HKD- $

-

Australian Dollar

AUD-$

-

Brazilian Real

BRL -R$

-

Swiss Franc

CHF -FR

-

Chilean Peso

CLP-$

-

Czech Koruna KČ

CZK -KČ

-

Singapore Dollar

SGD-S$

-

Indian Rupee

INR -₹

-

Saudi Riyal

SAR -SAR

-

Vietnamese Dong

VND-₫

-

Thai Baht

THB -฿