-

Preis: $0.15090 2.9605%

-

Marktwert: 22.92B 0.7601%

-

Umsatz (24h): 1.55B 0%

-

Dominanz: 0.7601% 0.7601%

-

Preis: $0.15090 2.9605%

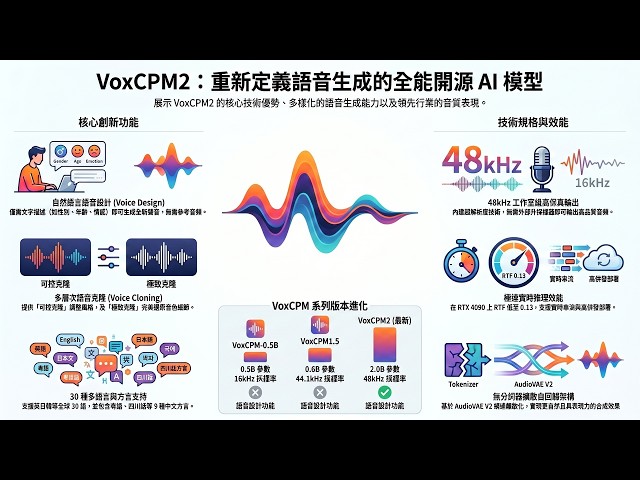

🎯 Hokkien-Dialekt kann auch von KI synchronisiert werden! 2B-Parameter schlagen 7B! VoxCPM2 analysiert vollständig dreißig Sprachen + neun Dialekte und verwendet kleinere Modelle, um realistischere Klänge zu erzeugen.

freigeben: 2026/05/11 04:51 lesen: 0

Ursprünglicher Autor:AI 論文白話文

Originalquelle:https://www.youtube.com/embed/afnxVzN_ZF4

🎤 Dieses Open-Source-Sprachmodell ist etwas anders. Was in der technischen Community für Diskussionen sorgt, ist nicht der Maßstab, sondern architektonische Durchbrüche! VoxCPM2 – OpenBMB-Team: 🧠 Kerndurchbruch: Diffusion Autoregressive → Verabschieden Sie sich vollständig von diskreten Token 🔊 Native 48-kHz-High-Fidelity-Klangqualität (kein externer Aufwärtskonverter erforderlich) 🌍 30 globale Sprachen + 9 chinesische Dialekte (einschließlich Hokkien!) 🎭 Sprachdesign: reine Textbeschreibung → neue Sounds aus dem Nichts erstellen 🎯 Dual-Track Klonen: kontrollierbares Klonen (flexibel) + ultimatives Klonen (Fidelität) 📊 Seed-TTS-Benchmark: 2B Parameter schlagen 7B Qwen2.5-Omni ⚡ RTF 0,13 (Nano-vLLM-Beschleunigung) → 7-mal schneller als menschliche Sprache 💾 Mindestens 8 GB VRAM zur Ausführung 🆓 Apache 2.0 vollständig Open Source und für die kommerzielle Nutzung verfügbar 💻 GitHub: https://github.com/OpenBMB/VoxCPM 🤗 HuggingFace: https://huggingface.co/openbmb/VoxCPM2 📄 Offizielle Dokumente: https://voxcpm.readthedocs.io/en/latest/models/voxcpm2.html [Kapitel 1: Durchbruch in der Kernarchitektur] 0:00 – VoxCPM2 (OpenBMB): 2 Milliarden Parameter, mehr als 2 Millionen Nach stundenlangem Training ist Apache 2.0 vollständig Open Source und kann kommerzialisiert werden. 0:18 – Autoregressive Diffusionsarchitektur: Verabschieden Sie sich vollständig von diskreten Token, verwenden Sie kontinuierliche Sprachdarstellung, um direkt native 48-kHz-High-Fidelity-Klangqualität zu erzeugen, ohne dass externe Aufwärtskonverter erforderlich sind [Kapitel 2: 30 Sprachen + 9 Dialekte] 0:55 – Native Unterstützung für 30 globale Sprachen, direkte Ausgabe ohne Beispiel (kein Sprach-Tag). erforderlich) 1:31 – Tiefgreifende Optimierung von 9 chinesischen Dialekten, einschließlich „Minnan“, das in der Open-Source-Branche selten nativ unterstützt wird [Kapitel 3: Sprachdesign (reiner Text zur Erzeugung von Klängen)] 1:56 – Eine reine Textbeschreibung (z. B. Geschlecht/Emotion/Sprachgeschwindigkeit) kann eine neue Stimme aus dem Nichts erzeugen, ohne jegliche Bezugnahme auf Audio 2:19 – Bei starkem Kontextbewusstsein ist eine Textbeschreibung ein dedizierter Mixer [Kapitel 4: Dual-Track-Stimmenklonen] 2:53 – Steuerbares Klonen (16-kHz-Audio + Text): Emotionen und Sprachgeschwindigkeit flexibel ändern, geeignet für virtuelle Anker 3:22 – Ultimatives Klonen (Audio + wörtlich): basierend auf Audiofortsetzung, 100 % Wiedergabetreue für jede Atempause, geeignet für Stimmreparatur [Kapitel 5: Das natürliche Gefühl von Tokenizer Free] 3:53 – Verabschieden Sie sich vom Verlust akustischer Details, der durch die erzwungene Segmentierung von verursacht wird Traditionelle Token 4:18 – Die Wellenform arbeitet direkt im kontinuierlichen Potenzialraum, ist glatt und natürlich und behält die subtilen Höhen und Tiefen menschlicher Emotionen perfekt bei [Kapitel 6: Native Hochskalierung von AudioVAE V2] 4:46 – Asymmetrisches Codec-Design, das die Superauflösung von 16 kHz auf 48 kHz direkt innerhalb des Modells vervollständigt 5:12 – Verzicht auf den externen Upsampler, Reduzierung der Wartungskosten und Fehlerquellen für den Unternehmenseinsatz [Kapitel 7: Fünfstufige End-to-End-Inferenz] 5:22 – Eingabe → Verstehen (MiniCPM-4) → Generierung (diffusionsautoregressiv) → Rendering (AudioVAE V2) → Ausgabe (0,13 RTF), um ein vollständiges akustisches Betriebssystem zu erstellen [Kapitel 8: Drei Generationen der Leapfrog-Evolution] 5:56 – Parameter von 0,5B auf 2B aktualisiert, vollständig auf 30 erweitert Sprache und Unterstützung aller Funktionen 6:42 – LM-Token-Rate stabil auf 6,25 Hz reduziert, um ultimative Leistung zu gewährleisten [Kapitel 9: Hardcore-Benchmark-Daten] 6:50 – Seed-TTS: 2B-Modell (WER 1,84/SIM 75,3) schlägt 7B Top-Open-Source-Modell 7:29 – 30 Sprach-ASR (interner Test): Die globale durchschnittliche Fehlerrate beträgt nur 1,68 % 8:13 – InstructTTSEval: Die drei wichtigsten emotionalen Befehlsindikatoren dominieren die Liste und beweisen ihr tiefes semantisches Verständnis [Kapitel 10: Extrem schnelle Inferenz und Bereitstellung] 8:46 – Geschwindigkeitsleistung: PyTorch-Standard 0,30 RTF; Nano-vLLM beschleunigt auf erstaunliche 0,13 RTF 9:07 – Unterstützt vLLM-Omni-Hochdurchsatzbereitstellung und bietet OpenAI-kompatible API für perfektes Andocken [Kapitel 11: Feinabstimmung und Open-Source-Ökosystem] 9:20 – Nur 5–10 Minuten Audio können verwendet werden, um SFT (tief) oder LoRA (leicht) Feinabstimmung durchzuführen, um exklusive Sounds zu erzeugen 10:04 – Deckt ab Server/Edge/ComfyUI-Ökosystem, kann mit mindestens 8 GB VRAM ausgeführt werden 10:43 – Open-Source-TTS-Optionen müssen im Jahr 2026 getestet werden, es wird dringend empfohlen, zur offiziellen Demo-Verifizierung persönlich zu gehen Szenarien━━━━━━━━━━━━━━━━━━━━━━ 📊 Kerndaten (strikt basierend auf SRT-Inhalten) ━━━━━━━━━━━━━━━━━━━━━━ • Entwickler: OpenBMB Team • Lizenz: Apache 2.0 (vollständig Open Source, im Handel erhältlich) • Architektur: Diffusion Autoregressive → Tokenizer Free • Backbone-Netzwerk: MiniCPM-4 • Parameter: 2B (2 Milliarden) • Trainingsdaten: Über 2 Millionen Stunden mehrsprachige Sprache • Native Abtastrate: 48 kHz (Studioqualität, kein externer Aufwärtskonverter erforderlich) • Sprachen: 30 globale Sprachen • Dialekte: 9 chinesische Dialekte (einschließlich Hokkien) • VRAM-Anforderungen: Mindestens ~8 GB • LM-Token-Rate: 6,25 Hz Inferenzgeschwindigkeit: Standard PyTorch: RTF 0,30 Nano-vLLM Beschleunigung: RTF 0,13 (etwa 7-mal schneller als Menschen) Vier Hauptfunktionen: 1. Sprachdesign (Voice Design): reine Textbeschreibung → Geräusche aus dem Nichts erzeugen 2. Steuerbarer Klon (kontrollierbar): Referenz-Audio + Text → veränderbare Emotion/Sprachgeschwindigkeit 3. Ultimativer Klon (Ultimate): Referenz-Audio + wörtlicher Entwurf → perfekte Wiedergabetreue-Fortsetzung 4. Zero-Sample-Mehrsprachigkeit (Zero Shot): Automatische Identifizierung von Kernmodulen ohne Sprach-Tags: LocEnc → TSLM → RALM → LocDiT → AudioVAE V2 (16→48 kHz) Benchmark (in SRT erwähnte Daten): Seed-TTS: WER 1,84 / SIM 75,3 (2B gewinnt 7B Qwen2.5-Omni) 30 Sprache ASR: Globale durchschnittliche Fehlerrate 1,68 % Englisch 0,42 % / Chinesisch 0,92 % / Arabisch 1,23 % / Indonesisch 1,36 % InstructTTSEval: APS 84,2 / DSD 83,2 / RP 71,4 (der höchste von allen dreien) ⚠️ 30 Sprache ASR ist internes Testen, unabhängige Evaluierung durch Dritte, Integration der Bereitstellung: • Nano-vLLM / vLLM-Omni (Hochdurchsatzserver) • ONNX plattformübergreifend/Apple Neural Engine • ComfyUI-Knoten • OpenAI kompatibel/v1/Audio/Sprache API • LoRA-Feinabstimmung (leichte multitimbrale Umschaltung) Drei Evolutionsgenerationen: VoxCPM-0.5B (ursprüngliche Generation): 0,5B / Chinesisch und Englisch / 16 kHz / 12,5 Hz VoxCPM-1.5 (stabil): 0,8 B / Chinesisch-Englisch / 44,1 kHz / 6,25 Hz VoxCPM2 (neueste): 2B / 30 Sprachen + 9 Dialekte / 48 kHz / 6,25 Hz ━━━━━━━━━━━━━━━━━━━━━━ 🎯 Hochwertige Anwendung Bereiche━━━━━━━━━━━━━━━━━━━━━━ ✅ Virtueller Anker: kontrollierbares Klonen + sofortiger Wechsel mehrerer Emotionen ✅ Dynamisches Hörbuch: emotionale Kontrolle + mehrere Rollen ✅ Historische Stimmwiederherstellung: originalgetreue Wiederherstellung des ultimativen Klonens ✅ Sprachfortsetzung: Nahtlose Fortsetzung spezifischer Stile ✅ Globale Produkte: 30 Sprachen ohne Beispiele ✅ Taiwan-Markt: Hokkien-Native-Unterstützung (nur Open Source) ✅ Enterprise-exklusive Stimme: 5-10 Minuten Daten → LoRA-Feinabstimmung → online ⚠️ GPU erforderlich (mindestens ~8 GB VRAM) ⚠️ Ergebnisse des Sprachdesigns können jedes Mal leicht unterschiedlich sein ⚠️ 30 Sprachen ASR Für interne Tests Daten━━━━━━━━━━━━━━━━━━━━━━ 🎬 Demo-Erfahrungsmethode (nur basierend auf SRT erwähnt) ━━━━━━━━━━━━━━━━━━━━━━ Vorschlag am Ende des Videos: „Gehen Sie zur offiziellen Demo-Seite und probieren Sie sie mit Ihrem eigenen Nutzungsszenario aus“ 🔗 GitHub: https://github.com/OpenBMB/VoxCPM 🤗 HuggingFace: https://huggingface.co/openbmb/VoxCPM2 Lokale Bereitstellung: pip install voxcpm Vorschläge für Demoskripte (entsprechend streng dem SRT-Inhalt): 1. Sprachdesign: Eingabe „tiefe männliche Stimme, traurig, langsames Sprechen“ + Text → Beobachten Sie den Effekt aus dem Nichts 2. Steuerbares Klonen: 16-kHz-Referenzaudio bereitstellen → Emotion und Sprechgeschwindigkeit ändern → Originalton vergleichen 3. Ultimatives Klonen: Referenzaudio + Verbatim Skript → Überprüfen Sie die Wiedergabetreue jedes Atemzugs und jeder Pause. 4. Zero-Sample-Mehrsprachigkeit: Keine Sprach-Tags. Geben Sie direkt chinesischen/englischen/japanischen/französischen Text ein. Beobachten Sie die automatische Erkennung https://www.openslr.org/12/ (Englische Stimme) #VoxCPM2 #OpenBMB #Speech Synthesis #TTS #DiffusionAutoregressive #TokenizerFree #48kHz #Voice Design #VoiceDesign #Voice Clone #30 Language #Min Nan Dialect #Chinese Dialect #MiniCPM4 #AudioVAE #LoRA #Open Source TTS #Apache2 #VoiceCloning #ZeroShot #VoiceAI ═══════════════════════════════════ ⚠️ Haftungsausschluss ═══════════════════════════════════ Dieses Video ist ein Interpretation und technische Überprüfung von Open-Source-Projekten im Bildungsbereich. Der Inhalt basiert auf dem offiziellen GitHub-Repository von OpenBMB, der HuggingFace-Modellkarte und technischen Dokumenten. Es handelt sich um eine direkte Übersetzung der inoffiziellen Originaldokumente. Das Urheberrecht aller Codes, Modellgewichte, Benchmark-Daten und zitierten Inhalte liegt beim OpenBMB-Team und der Open-Source-Community. Bei einigen Benchmark-Tests handelt es sich um interne Daten und nicht um unabhängige Bewertungen Dritter. Bitte halten Sie sich bei der Verwendung der Funktion zum Klonen von Stimmen an die örtlichen Gesetze und Vorschriften. Sie darf nicht dazu verwendet werden, andere zu betrügen oder sich als andere auszugeben. Die technische Umsetzung ist zeitkritisch. Wenn Sie Fragen haben, schauen Sie bitte unbedingt im offiziellen Repository nach, um die neuesten Informationen zu erhalten. 🔗 https://github.com/OpenBMB/VoxCPM

aktuelle Nachrichten

Mehr>>-

Electro Cubos

2026-05-11 14:50

Electro Cubos

2026-05-11 14:50

-

Zala2626

2026-05-11 14:38

Zala2626

2026-05-11 14:38

-

Thohir - block

2026-05-11 14:38

Thohir - block

2026-05-11 14:38

-

剧能充电站

2026-05-11 14:38

剧能充电站

2026-05-11 14:38

-

C-Minidrama

2026-05-11 14:38

C-Minidrama

2026-05-11 14:38

-

Sweety Theater

2026-05-11 14:16

Sweety Theater

2026-05-11 14:16

-

RushMiniDrama

2026-05-11 14:16

RushMiniDrama

2026-05-11 14:16

-

破晓动漫社 Dawn Anime Club

2026-05-11 14:16

破晓动漫社 Dawn Anime Club

2026-05-11 14:16

-

AI 論文白話文

2026-05-11 13:55

AI 論文白話文

2026-05-11 13:55

Ausgewählte Themen

-

- Dogecoin-Wal-Aktivität

- Erhalten Sie mit unserer umfassenden Analyse die neuesten Erkenntnisse über die Aktivitäten der Dogecoin-Wale. Entdecken Sie Trends, Muster und die Auswirkungen dieser Wale auf den Dogecoin-Markt. Bleiben Sie mit unserer Expertenanalyse auf dem Laufenden und behalten Sie auf Ihrem Weg zur Kryptowährung die Nase vorn.

-

- Dogecoin-Mining

- Beim Dogecoin-Mining werden der Dogecoin-Blockchain neue Transaktionsblöcke hinzugefügt. Miner werden für ihre Arbeit mit neuen Dogecoins belohnt. Dieses Thema enthält Artikel zum Dogecoin-Mining, einschließlich der Anleitung zum Mining von Dogecoin, der besten Mining-Hardware und -Software und der Rentabilität des Dogecoin-Minings.

-

- Start des Spacex-Raumschiffs

- Dieses Thema enthält Artikel zu SpaceX-Raumschiffstarts, einschließlich Startdaten, Missionsdetails und Startstatus. Bleiben Sie mit dieser informativen und umfassenden Ressource über die neuesten Starts von SpaceX Starship auf dem Laufenden.

-

- König der Meme: Dogecoin

- Dieses Thema enthält Artikel zu den beliebtesten Memes, darunter „The King of Memes: Dogecoin“. Memecoin hat sich zu einem dominanten Akteur im Kryptoraum entwickelt. Diese digitalen Assets sind aus verschiedenen Gründen beliebt. Sie treiben die innovativsten Aspekte der Blockchain voran.

Ausgewählte Artikel

Mehr>>- 1 Arctic Pablo Coin (APC): Aufdeckung der Geheimnisse der Erde, einer Vorverkauf nach dem anderen

- 2 Neue Höhen für Dogecoin, Pepe und Shiba Inu im Jahr 2025, aber diese Krypto kann die Show mit 10.000% Gewinnen stehlen

- 3 Meme Coin Doge Uprising (DUP) könnte 100x, nachdem Präsident Donald Trump die Strategische Reserve von Crypto angekündigt hatte

- 4 Dogecoin (Doge) Preisvorhersage: Könnte Meme Coin bis Ende 2025 10 US -Dollar erreicht?

- 5 Cardanos Charles Hoskinson hat einige bemerkenswerte Bemerkungen zu Bitcoin und Dogecoin gemacht

- 6 Cloud Mining Craze: Bitcoin, Dogecoin und die Suche nach passivem Kryptoeinkommen

- 7 Grayscale, Dogecoin und das ETF-Debüt: Eine neue Ära für Meme-Coins?

- 8 Rexas Finance (RXS) könnte bis 2025 10x steigen und Pepe (Pepe) übertreffen

- 9 Bitcoin -Händler, der 30 Millionen US -Dollar für Doge verdiente

- 10 Dogecoin (DOGE) Preisvorhersage: Meme-Münze könnte sich auf 0,27 USD versammeln

Währung auswählen

US Dollar

USD

Chinese Yuan

CNY

Japanese Yen

JPY

South Korean Won

KRW

New Taiwan Dollar

TWD

Canadian Dollar

CAD

Euro

EUR

Pound Sterling

GBP

Danish Krone

DKK

Hong Kong Dollar

HKD

Australian Dollar

AUD

Brazilian Real

BRL

Swiss Franc

CHF

Chilean Peso

CLP

Czech Koruna KČ

CZK

Singapore Dollar

SGD

Indian Rupee

INR

Saudi Riyal

SAR

Vietnamese Dong

VND

Thai Baht

THB

Währung auswählen

-

US Dollar

USD-$

-

Chinese Yuan

CNY-¥

-

Japanese Yen

JPY-¥

-

South Korean Won

KRW -₩

-

New Taiwan Dollar

TWD-NT$

-

Canadian Dollar

CAD-$

-

Euro

EUR - €

-

Pound Sterling

GBP-£

-

Danish Krone

DKK-KR

-

Hong Kong Dollar

HKD- $

-

Australian Dollar

AUD-$

-

Brazilian Real

BRL -R$

-

Swiss Franc

CHF -FR

-

Chilean Peso

CLP-$

-

Czech Koruna KČ

CZK -KČ

-

Singapore Dollar

SGD-S$

-

Indian Rupee

INR -₹

-

Saudi Riyal

SAR -SAR

-

Vietnamese Dong

VND-₫

-

Thai Baht

THB -฿